Advances in Mathematics Research. Volume 30

Some of the latest advancements in mathematics research

Editor: Albert R. Baswell

Series: Advances in Mathematics Research

The Author of the First Chapter is Mr. Claudio Garuti Anderlini, CEO at Medical Sapiens SpA

February 17,2022

This volume includes some of the latest advancements in mathematics research. Chapter One aims to increase the certainty and reliability of G index through different examples and show that G index can be reached by two different paths. Chapter Two focuses on deriving exact trigonometric ratios using equations. Chapter Three presents a review of rough set theory-based feature selection approaches for small to large scale machine learning tasks. Chapter Four delivers an analytic approach to the Riemann hypothesis. Chapter Five aims to present a comparative analysis of mathematical models of transmission lines applied to two short lines of medium voltage. Finally, Chapter Six focuses on the numerical investigation of the one and two dimensional semi-linear scale-invariant wave equation with damping, mass and power non-linearity.

Chapter 1 is aimed to increase the certainty and reliability of G index through different examples and showing that G index can be reached by two different paths, first using vector algebra as a weighted vector projection apply- ing the concept of inner vector product and next, applying main concepts of set theory. Finally, comparing G index with others known compatibility indices. And, using set theory, showing that the G index is a sort of generalization of the Jaccard (J) index that considers the weights of the elements of two different sets. Making it applicable in the decision-making domain to measure similarity (compatibility) between priority vectors, system values and recognition of be- havioral patterns among others features. There is huge number of applications of G index in different fields, such as:

- On Group Decision Making; measuring how close are the value systems that belong to different people.

- On Quality Tests; measuring what MCDM decision method is building a better metric.

- On Agriculture; measuring the proximity between the cultivated plants against a healthy plant (based on its micro and macronutrients) and selecting the best nutrient seller.

- On Shift-work Prioritization; measuring how close are the different views among the different stakeholders (Workers view, Company view, Com- munity view).

- On Company Social Responsibility (CSR); measuring how close are the different views among the different stakeholders (Economic, Environ- mental and Social view).

- On Natural Risk Disaster & Management; to enhance the resource alloca- tion process (aligning resources with priority hazards and social vulnera- bilities).

References

“Advances in Mathematics Research. Volume 30”, Nova Science Publishers

¿Cómo impactar en Salud?

¿Podemos mejorar en forma oportuna el Diagnóstico Médico?

Autor: Dr. Mario Sandoval Martínez

RCM: 16.085-7

7 Agosto 2021

En Chile, según los datos disponibles del MINSAL (finales del 2017) había 1.611.477 interconsultas pendientes a especialistas, un 10 % más que el 2015. El retraso incluía hasta 6 años de demora en resolverse. Lo anterior, en un marco de diagnósticos sin ninguna priorización, es decir, da lo mismo un reflujo gastroesofágico que un cáncer. La situación, solo ha empeorado en el contexto de la pandemia de Covid-19.

El déficit de especialistas al 2015 era de 3795 médicos. Se ha hecho un esfuerzo extraordinario en aumentar la formación de especialistas, la mayor parte de los cuales, una vez formados, permanecen en Santiago, acrecentando el abandono de las regiones. Con la mayor formación, ajustes “administrativos”, externalización (licitación de listas de espera a privados), en 2 años se logró disminuir sólo un 22% los días de espera promedio, lo cual no resuelve el problema, pues esperar 727 días o algo menos de 600 es igualmente humillante para los pacientes y vergonzoso para un país.

La propuesta es que nuestros médicos no especialistas logren resolver diagnósticos en forma oportuna, traten adecuadamente las enfermedades, evitando las complicaciones que hacen aumentar el costo de tratamiento, aumentan el ausentismo laboral y los costos de seguros del trabajo y de licencias médicas.Se requiere de:

- Decisión política de avanzar en salud con:

- Ficha única nacional digitalizada

- Interoperabilidad entre sistemas de registros de salud

- Elevar la capacidad de Diagnóstico de los médicos de atención primaria (una herramienta es www.medicalsapiens.com) .

Inteligencia Artificial vs. Inteligencia Aumentada

La Inteligencia Aumentada no se opone a la IA, sino que nos ofrece una manera de usar la IA en situaciones de la vida real.

Autora: Franca Oppici

24 Mayo 2021

Cualquier sistema inteligente puede encontrarse con una situación en la que la intervención humana es esencial, donde se requiere inteligencia humana para el funcionamiento completo del agente. Este cruce de mundos es la clave para aumentar tanto la inteligencia humana como la artificial. Podemos mejorar las capacidades de ambas entidades introduciendo el comportamiento y el contexto como variables en el proceso cognitivo.

En enero de 2015 se publicó una carta abierta dirigida a la amplia comunidad de investigadores en IA, causando un gran revuelo dado que entre los prominentes firmantes estaban el CEO de Tesla, Elon Musk y el físico teórico de Cambridge Stephen Hawking. La carta destacaba los aspectos positivos y negativos que puede tener la IA, sosteniendo lo siguiente:

“Los beneficios potenciales de la IA son enormes, ya que todo lo que la civilización tiene para ofrecer es producto de la inteligencia humana; no podemos predecir lo que podríamos lograr cuando esta inteligencia se magnifique con las herramientas que la IA puede proporcionar, pero la erradicación de la enfermedad y la pobreza no son insondables. Debido al gran potencial de la IA, es importante investigar cómo aprovechar sus beneficios y evitar posibles peligros.”

Esta carta abierta, firmada no sólo por Musk y Hawking, sino por cientos de profesionales en el campo, pedía una precaución sensata y un estudio de los peligros sociales, económicos, políticos e incluso militares que la IA podría presentar.

La preocupación expresada por estos destacados científicos y profesionales en el área es inusual, pero debemos pensar que desde sus inicios, en los años 50, la IA ha pasado por altos y bajos. Los gobiernos y los inversionistas en IA han tratado de seguir este ciclo, y es así como, cuando se produce un colapso en el interés en la IA, generalmente después de un período con algunos éxitos interesantes, surge la idea de la Inteligencia Aumentada en vez de la Inteligencia Artificial.

La diferencia entre estos dos campos, tan cercanamente relacionados pero tan distintos a la vez, puede ser la clave para entender la promesa y el rumbo que puede tomar el desarrollo de la Inteligencia Artificial.

Inteligencia Artificial - Inteligencia Aumentada: dos enfoques muy diferentes producen resultados muy distintos

La inteligencia artificial (IA) se refiere a la simulación de la inteligencia humana en sistemas informáticos que están programados para pensar como humanos e imitar sus acciones. El término también se puede aplicar a cualquier máquina o sistema que exhiba rasgos asociados con una mente humana, como el aprendizaje y la resolución de problemas.

La inteligencia aumentada, por otro lado, se refiere a un sistema informático que complementa y apoya el pensamiento, el análisis y la planificación humanos, dejando la intencionalidad de un actor humano en el centro de la interacción humano-computadora. Debido a que el aumento de inteligencia se centra en la interacción de humanos y computadoras, en lugar de solo en computadoras, también se lo conoce como HCI (Human Computer Interaction).

A principios de los ’70 el profesor de Stanford Terry Winograd fundó el Stanford Human-Computer Interaction Group. Su nombre no es muy conocido por el público, pero si los nombres de dos de sus estudiantes: Larry Page y Sergey Brin, los cofundadores de Alphabet, Inc. (GOOGLE).

Según Winograd, las computadoras nunca podrán realizar el tipo de pensamiento humano que no es algorítmico: el pensamiento que nos permite interpretar declaraciones vagas, evaluar intuitivamente una situación basada en datos que nunca se vuelven explícitos, o seleccionar de inmediato fenómenos sensoriales relevantes sin analizar exhaustivamente todas las entradas. Pero son excepcionalmente buenos en el "trabajo pesado" mental: el análisis por la fuerza bruta, un examen exhaustivo de todo un conjunto de posibilidades.

Por lo tanto, los "chicos de Google" provienen de un linaje de investigación que no estaba orientado al objetivo de la IA de modelar la inteligencia humana de manera exhaustiva y matemática, sino al objetivo más simple de HCI, de usar computadoras para hacer el trabajo de fuerza bruta en el que son mejores, dando un lugar de honor a los humanos, cuyas intenciones y deseos están en dirigir lo que hacen las computadoras.

Los efectos del diseño y desarrollo inspirado en HCI han sido mucho más concretos y notables que la IA, brindándonos Internet, el uso de algoritmos de búsqueda para representar Internet como una vasta enciclopedia, la interfaz gráfica de usuario, las pantallas táctiles y el gran salto en las interfaces: dispositivos de realidad virtual y aumentada. Todos estos desarrollos provienen de la disciplina de HCI y no de la IA.

La Inteligencia Aumentada no se opone a la IA, sino que nos ofrece una manera de usar la IA en situaciones de la vida real. Tal como dijo Ben Dickson (ingeniero de software y fundador de TechTalks): "La inteligencia aumentada se refiere al resultado de combinar la inteligencia humana y la máquina ..."

La IA no es perfecta

La IA no es perfecta, así como no somos perfectos los seres humanos. Las causas pueden ser muchas: mala calidad de los datos, modelos de dominio equivocados, sesgos en la información, interpretaciones equivocadas de los resultados entregados, etc. Sin embargo, siempre podemos decir que los algoritmos estadísticos en los que se basa la IA pueden tener un margen de error, pero aún así, pensar que la IA va a responder mejor que un ser humano. No siempre es así… Sólo pensemos en un auto que se maneja solo, enfrentado a condiciones de clima adversas. Seguramente, en este caso hoy aún se requiere la intervención del conductor.

¿Qué ocurre si se produce una situación excepcional, distinta al común de los casos, será capaz el sistema de responder adecuadamente, aún cuando pueda darse cuenta de que existe esta excepción? Seguramente no, porque no dispone de la suficiente información para tomar la mejor decisión para este caso particular. Aquí nuevamente se requiere la intervención del ser humano.

Efectivamente la IA puede analizar grandes volúmenes de datos, tantos que ni siquiera los podemos imaginar, en centésimas de segundos. Sin embargo, aunque pueden no fallar de la misma manera que fallan los seres humanos, cuando fallan, puede ser catastrófico, porque su análisis pasa por alto cosas que sólo una inteligencia humana notaría.

Más aún, dependiendo del ámbito o el área de aplicación de la inteligencia artificial, en muchos casos se requiere agregar una capa de empatía a la decisión que toma un sistema. Como dice Larry Greenemeier (Scientific American): "Tomamos decisiones no sólo basadas en el pensamiento racional, sino también en valores, ética, moralidad, empatía, intuición y un sentido del bien y el mal, todas cosas que las máquinas no tienen inherentemente". Por lo tanto, a veces se requiere agregar ese toque emocional, personal y social a las decisiones.

Empoderando al ser humano

Esta es una de las mayores complejidades a las que se ve enfrentada la IA: empoderar a los usuarios para que sean capaces de rechazar una decisión o consejo entregado por un sistema que costó muchos millones de dólares para ser desarrollado.

No sólo tenemos que estar capacitados para desafiar los consejos y las decisiones tomadas por los sistemas basados en inteligencia artificial, sino que también debemos estar calificados para hacerlo. Debemos tener suficiente conocimiento y experiencia en el área en la que esta tecnología nos está ayudando. Si carecemos de ese conocimiento, no somos la contraparte adecuada para el sistema de IA.

La pregunta que surge entonces es cómo preparamos al ser humano para interactuar adecuadamente con los sistemas de IA, sacándole el mayor partido a los algoritmos inteligencia artificial, a la capacidad de procesar grandes volúmenes de datos en centésimas de segundos y a la capacidad de aprendizaje que éstos poseen, pero siendo capaces de analizar, evaluar y rebatir las decisiones o consejos entregados, con el fin de llegar a la mejor decisión para una determinada situación, y que el resultado de este análisis pueda ser incorporado al sistema para futuras toma de decisiones.

Conclusiones

Si bien la inteligencia artificial tiene como objetivo los sistemas informáticos autónomos, la disciplina relacionada de "aumento de la inteligencia" tiene un objetivo más humilde: aprovechar las mejores fortalezas de las computadoras mientras se mantiene a los seres humanos en el centro del escenario. Los defensores del aumento de la inteligencia, incluido uno de los mentores académicos de los fundadores de Alphabet, se muestran escépticos de que algunos aspectos críticos de la inteligencia humana alguna vez se modelen con computadoras. La Inteligencia Aumentada ha producido algunos de los desarrollos más poderosos en tecnología de la información, mientras que la IA ha tendido a seguir ciclos de auge y caída, de optimismo extravagante seguido de decepción. Parece difícil creer que la IA alguna vez sustituya los aspectos profundamente humanos de la inteligencia, que son fundamentales en casi todas las disciplinas del conocimiento humano.

Fuentes

“The Artificial Intelligence vs. Intelligence Augmentation Debate”, Monty Guild, Tony Danaher

“Augmented artificial intelligence: Will it work?”, Reinoud Kaasschieter

Una Metodología para la Toma de Decisiones

AHP/ ANP: Construyendo una Métrica Decisional

Autores: Claudio Garuti A. - Isabel Spencer G.

6 Mayo 2021

Hoy en día, los profesionales constantemente recurren a diversas técnicas que les permiten resolver materias específicas. Sin embargo, surgen dificultades cuando deben enfrentarse a elementos para los cuales no hay medida. En esos casos, las técnicas estándares no son herramientas de trabajo adecuadas.

Es por ello que, en nuestra sociedad los valores sociales requieren de métodos que permitan evaluar las diferencias entre dinero, calidad ambiental, salud, felicidad y entidades similares. Tal enfoque es necesario precisamente porque no hay escalas sociales de medida que hayan adquirido popularidad, aun cuando ha habido varios intentos en las ciencias sociales para crear los fundamentos de una teoría de la medida.

Compartiendo este interés, a fines de los setenta, el profesor Thomas L. Saaty, Doctor en Matemáticas de la Universidad de Yale, creó un modelo matemático denominado Proceso Jerárquico Analítico o AHP (por sus siglas en inglés); como una forma efectiva de definir medidas para tales elementos y usarlas en los procesos de toma de decisiones.

El AHP es una teoría que está orientada hacia el o los responsables de la toma de decisiones, y sirve para identificar la mejor alternativa de acuerdo a los recursos asignados. Este método puede aplicarse a situaciones que involucran factores de tipo técnico, económico, político, social y cultural. Es decir, pretende ser una herramienta científica para abordar aquellos aspectos que son difícilmente cuantificables, pero que requieren de una unidad de medida. La complejidad del asunto se hace evidente cuando los que toman decisiones requieren darle un valor específico, por ejemplo, a la vida humana, a una especie en extinción, a la calidad de vida de un grupo determinado, etc.

Esta teoría permite trabajar con varios escenarios a la vez, los que pueden dar prioridad a los objetivos de tipo: económico, ambiental, cultural, político, etc., según el escenario que se quiera evaluar. Además, este método permite la participación de distintos grupos, manejando varios objetivos, criterios y alternativas simultáneamente. Su uso ayuda al grupo de trabajo a obtener consenso entre los intereses de los distintos participantes, o grupos de poder.

Estas ideas se han ido gradualmente incorporando a otros ámbitos de aplicación, que van desde la ubicación de instalaciones de energía, Planificación de carteras de inversión, investigación en tecnologías bajo incerteza, Planificación territorial, asistencia al diagnóstico médico, etc...

Es importante hacer notar que por las características descritas, esta metodología se ajusta muy bien a los problemas donde las variables en juego son de distinta índole (económicas, políticas, sociales, culturales o ambientales) y en general de difícil medición. Por este motivo, en varios países del mundo el AHP y el ANP (generalización del AHP), está siendo aplicado como una metodología de creación de métrica donde no la hay, o si la hay no es compartida por los tomadores de decisión.

Descripción del Método

La jerarquía, base del método AHP, es una abstracción de la estructura de un sistema, que permite estudiar las interacciones funcionales de sus componentes y su impacto global sobre el sistema. Esta abstracción puede asumir diferentes formas, que esencialmente descienden de un objetivo general, a sub-objetivos, sub-sub-objetivos y así sucesivamente.

Conviene destacar el grado de estabilidad de esta estructura, cuyos niveles más altos corresponden a consideraciones estratégicas, mientras que los niveles inferiores representan los mecanismos operativos que permiten concretar los anteriores.

La Jerarquía es un modelo de una situación de la vida real. Representa nuestro análisis de los elementos más relevantes en dicha situación y de cómo se relacionan. Por sí sola, la jerarquía no es una ayuda muy poderosa en el proceso de planificación o toma de decisiones. Se requiere un método científico para determinar el peso relativo con el que los elementos de un nivel influyen sobre los elementos del nivel superior y sobre los objetivos estratégicos.

Para determinar el peso, o las prioridades de los elementos de un nivel, relativo a su importancia para un elemento del nivel siguiente, debe previamente transformarse en un problema matemático preciso. Este paso esencial y aparentemente inocente es el más crucial de cualquier problema que requiera la representación de una situación de la vida real en términos de una estructura matemática abstracta. Es entonces deseable identificar los pasos principales en el proceso de representación y hacer cada paso lo más explícito posible, para permitirle al usuario potencial, formar su propio juicio en el significado y valor del método en relación a su problema y sus objetivos.

Una de las contribuciones más importantes del método en el marco de la resolución de conflictos es que, tanto en el AHP como en el ANP, los grupos en conflicto estructuran el problema en conjunto desde el principio, es decir, construyen en conjunto su regla de medida, en vez que esto sea hecho por una tercera parte y después negociar los valores numéricos obtenidos. Y en directa relación con ello, está el cómo obtener consenso de los distintos juicios de un grupo.

Este proceso de obtención de consenso puede ser utilizado para demostrar a las personas que sus intereses están siendo considerados; de este modo, el consenso significa aumentar la confianza en los valores de las prioridades obtenidas. Sin embargo, el consenso no es un requerimiento, coexiste con el pluralismo, y esto es representable en el modelo mediante el manejo de modelos para cada actor por separado y un modelo combinado.

Etapas Básicas del Método

El AHP consta de tres etapas básicas:

- Primero

- Segundo

- Tercero

El problema (Objetivo general) es descompuesto en subobjetivos, llamados también criterios estratégicos, tales como: impacto ambiental, político, económico, etc.... Los que son agrupados en diferentes niveles tal que formen un árbol jerárquico.

El peso o grado de importancia de cada criterio en un nivel cualquiera de la jerarquía, es medido por una comparación sistemática de cada elemento respecto del resto de los elementos pertenecientes al mismo nivel.

La escala de comparación entre pares de criterios en un nivel está constituida por juicios de valor dentro de un rango de importancia, que va desde igual a extremadamente, (igual, moderado, fuerte, muy fuerte, extremadamente). A cada juicio de valor le corresponde un valor numérico absoluto (1, 3, 5, 7, 9) pertenecientes a una escala absoluta (invariante bajo la transformación identidad Y=X). Existiendo además valores de compromiso (2, 4, 6, 8). Estos valores indican cuantas veces un criterio es considerado más importante que el otro. Los valores recíprocos (1, 1/3, 1/5,....) son utilizados cuando la dominancia es inversa. Esto genera una matriz recíproca positiva, con la unidad en la diagonal principal.

Para cada matriz de comparaciones a pares se genera un vector de prioridades, y que está dado por el vector propio de dicha matriz. Este vector de prioridades, corresponde a una escala de proporciones absoluta, (invariante bajo la transformación identidad Y=X). Este vector es entonces transformado por las prioridades de los niveles superiores de la jerarquía, los que a su vez fueron los criterios con los cuales se construyeron las matrices de comparaciones a pares,

Este procedimiento es repetido hacia abajo en la jerarquía tantas veces como niveles tenga (principio de superposición jerárquica), calculando los pesos de cada criterio en cada nivel, usando éste para determinar los pesos compuestos en los niveles inferiores, y finalizando con las distintas alternativas o estrategias a seguir. Geométricamente este procedimiento se puede entender como un cambio de coordenadas de los vectores de cada matriz en cada nivel, para de esta forma obtener las coordenadas (ranking de prioridades) de las alternativas con respecto del Objetivo general buscado.

Las prioridades así obtenidas son muy estables, es decir, al hacer pequeños cambios en los juicios numéricos éstas no varían de forma notoria.

Existen distintos paquetes computacionales que implementan la metodología AHP, y que permiten análisis de sensibilidad y estabilidad, para validar los efectos de incerteza en las comparaciones y su estabilidad frente a los cambios de escenarios, ayudando así a la selección de la mejor alternativa. Algunos ejemplos de estos son: Expert Choice, Super Decision, Decision Lens, Total Decision (este último en español, desarrollado en Chile y representado por Fulcrum Ingeniería).

Claudio Garuti es Ing. Civil de la UChile con Postgrado en la U.Roma; Isabel Spencer es Ing. Civil Matemático de la UChile.

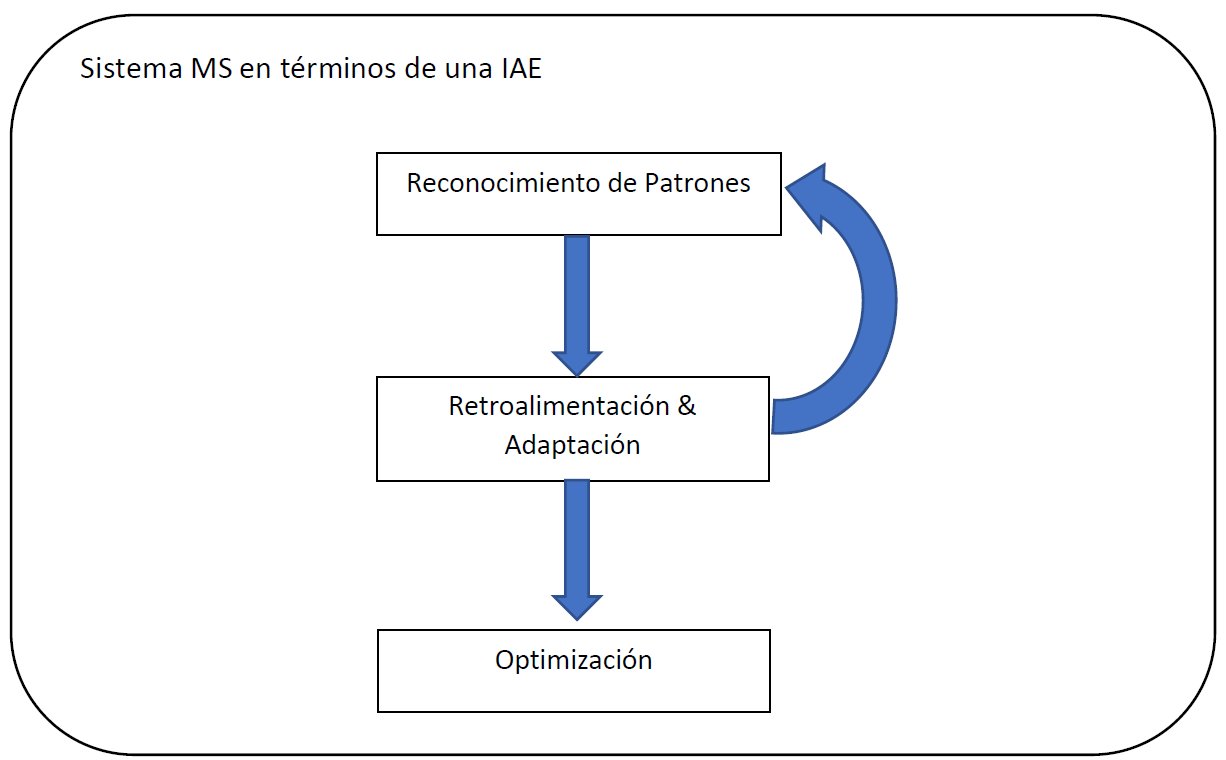

Inteligencia Artificial (IA) e Inteligencia Artificial Etica (IAE)

Relación con el Sistema de Soporte a la Decisión Medica, Medical Sapiens (MS)

Autor: Claudio Garuti Anderlini

20 Marzo 2021

El concepto de IA es un concepto relativamente nuevo que está siendo utilizado cada vez con mayor frecuencia. La importancia de este concepto tiene que ver en general con la capacidad aumentada de lo que entendemos como inteligencia.

Sin embargo, es un concepto delicado y fácil de mal utilizar y/o mal interpretar. Esto, obliga a entender bien que es la IA, en que se basa o debiera basarse y sus formas de operación práctica.

En primer lugar, me gustaría hacer un punto respecto a la diferencia entre IA e IAE. La IA en general se piensa como un programa o maquina capaz de responder preguntas difíciles a partir de generar relaciones relativas a la pregunta dentro de BD relacionales de muy gran tamaño. Esto, lleva en general, a obtener resultados sobre en que no se tiene claridad de cómo se obtuvieron (cual fue el "raciocinio" que estuvo detrás). Esto, en el largo plazo, puede traer problemas importantes de entendimiento y dependencia. En última instancia, estaríamos obedeciendo a una maquina en función de su eventual alta capacidad predictiva. Pero, en tal caso, ¿quién es realmente el decisor y quién el operador?

Este es un punto muy delicado, ya que el ser humano al perder la capacidad de manejo o administración sobre la decisión, por su incapacidad de entender por qué resultó lo que resultó, pierde también su libertad de acción (algunos la llaman la libertad de equivocarse), aunque yo prefiero definirla como "entrar a un grado de dependencia peligrosa".

La verdad es que, aunque partiéramos de la hipótesis de que la maquina nunca se equivoca (la decisión la tomó la maquina y la maquina no se equivoca), es un hecho que esto nos quita un grado importante de libertad en la toma de decisiones (nos aleja de este crucial proceso como especie).

Como contrapunto, la Inteligencia Artificial Ética (IAE) se define como una IA en que el ser humano es capaz, en términos generales, de entender la secuencia o procedimiento realizado por la IA para llegar al resultado. En este caso, la IA pasa a ser un aumentador de la capacidad de inteligencia natural (humana o de otra especie).

Este último punto, entender la secuencia o procedimiento realizado por la IA, es logrado de forma natural en el sistema Medical Sapiens (MS), gracias a la forma como fue construido, esto es, basado en métrica topológica (topología del orden) en vez de métrica estadística (BD relacionales), sin desvirtuar la utilidad de esta última (de hecho, también existen análisis de este tipo en MS, la que se conoce como analítica de datos y procesos), es decir, no es que una reemplace la otra la idea es utilizar cada una en su justa medida, de forma tal que siempre sea posible seguir el proceso de raciocinio simulado o real.

Otro punto muy importante (básico), es entender los principios elementales que presenta o debe presentar todo tipo de inteligencia, sea esta natural o artificial.

De las capacidades de un IA

A continuación, se presenta, en orden de importancia, los 3 principios o capacidades básicas con que debe contar toda IA y su grado de cumplimiento en el sistema de soporte a la decisión médica MS:

- Capacidad de Reconocimiento de Patrones

- Capacidad de Retroalimentación (adaptabilidad)

- Capacidad de Optimización (eficiencia)

Una de las principales características de la inteligencia es su capacidad de reconocer patrones, sin esta capacidad ningún sistema es capaz de sobrevivir. De hecho, nuestro propio cerebro comienza muy tempranamente a trabajar en la construcción de esta capacidad.

Una vez la capacidad de reconocimiento de patrones se halle construida, es importante tener una capacidad de retroalimentación, es decir, una capacidad de recibir nueva información y adaptarse a esta nueva realidad. Esta capacidad de adaptabilidad es muy importante para mantener aggiornato al sistema. Sin embargo, se debe aclarar que esta capacidad no debe pensarse como un reemplazo o sustituto de la capacidad numero uno. De hecho, esta capacidad debe siempre ser contrastada con la primera, tal que su impacto se produzca de manera progresiva. La manera en que se vaya modificando el patrón inicial debe ser relativamente lenta en la medida que nueva información se vaya agregando y que verifique el cambio sugerido, Esto, para evitar cambios abruptos (discontinuos), que no reflejen la realidad.

Nota: en los modelos de decisión se usa aceptar un grado máximo de inconsistencia en la información, tal de aceptar nueva información que pudiera no ser consistente con la ya existente. Sin embargo, ese grado de inconsistencia es bastante acotado (en general no supera el 10%), tal que permita un cambio, pero que este sea pausado (cambio aceptable o integrable al patrón existente).

La última capacidad corresponde a la capacidad de optimización que posea el sistema, esta capacidad está íntimamente ligada al mejoramiento de la eficiencia del sistema (hacer el mismo trabajo en una menor unidad de tiempo o espacio). Si bien esta capacidad es importante de revisar, muchas veces el avance mismo de la tecnología permite de forma natural (casi automática), su logro. Sin embargo, siempre se debe estar atento a mantener un proceso de registro, procesamiento y presentación lo más eficiente posible.

De la Relación entre las Capacidades y el Sistema Medical Sapiens

En cuanto a la relación del sistema de soporte a la toma de decisiones médicas Medical Sapiens, este cumple con la primera y más importante condición (capacidad de reconocimiento de patrones). De hecho, producto de la forma en que fue construido, esta es una de sus principales características del sistema de soporte a la decisión medica MS. Respecto a la segunda capacidad (retroalimentación), ésta actualmente se está haciendo de forma manual. Sin embargo, uno de los objetivos de corto plazo es automatizar o semi-automatizar este proceso de actualización de los patrones de enfermedades establecidas en el sistema. Cabe resaltar que, en este mismo punto, es posible la construcción de nuevos patrones de enfermedades no existentes o desconocidos previamente por el sistema.

A partir del análisis anterior, podemos concluir que el Sistema MS cumple completamente con las dos primeras capacidades, las más importantes de cualquier IA.

La última capacidad, es un proceso continuo que se debe hacer de forma paralela al crecimiento natural del sistema.

Estas capacidades aplicadas al sistema de soporte a la decisión médica pueden ser visualizadas en la siguiente figura (simplificada):